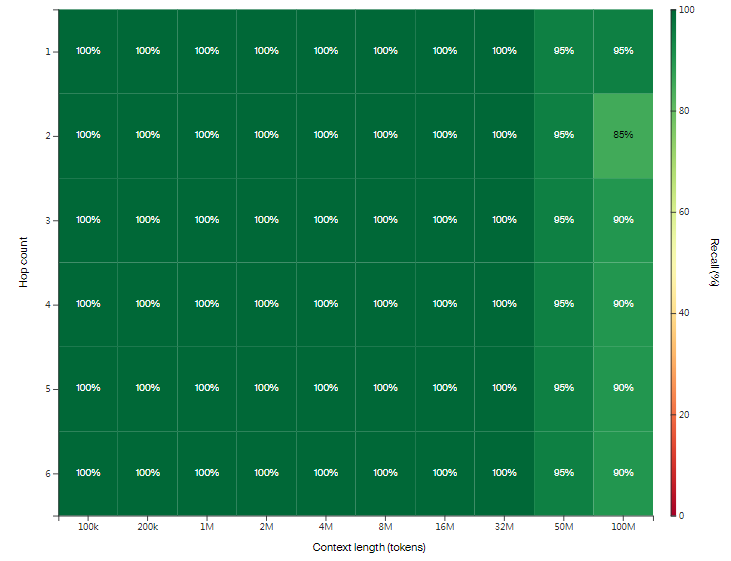

LTM-2-Mini,100M(即1亿)上下文token,且运行成本比LLaMA 3 405B便宜1000倍。

此前最长的上下文是谷歌在研究阶段的模型,10M上下文;普通用户可以用到的是Gemini Pro,2M上下文。

长上下文终归是好的,不过现在限制很多,比如Gemini的上下文是2M,但仅限输入,单次输出的长度还是限制在8K,通过不断要求“继续”才能输出完整。

官方博文:https://magic.dev/blog/100m-token-context-windows

微信扫描下方的二维码阅读本文

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。

评论(0)