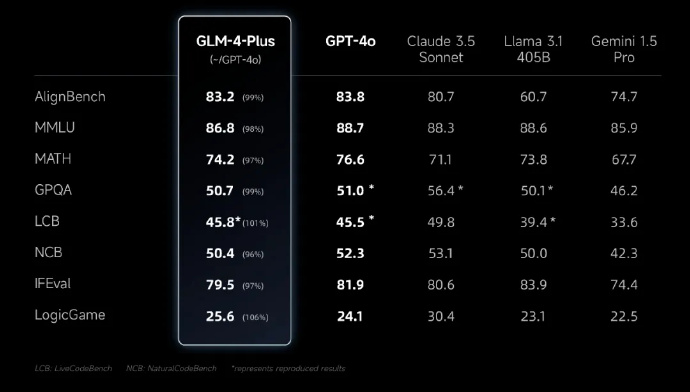

GLM-4-Plus 使用了大量模型辅助构造高质量合成数据以提升模型性能;利用 PPO 有效有效提升模型推理(数学、代码算法题等)表现,更好反应人类偏好。

GLM-4V-Plus 在图像和视频理解能力方面位居前列。GLM-4V-Plus 还可以理解网页内容,并将其转换为 html 代码。

GLM-4V-Plus 能够理解并分析复杂的视频内容,同时具备时间感知能力。上线开放平台后,将提供国内首个通用视频理解模型 API 。

文生图模型迎来最新版本CogView-3-Plus,其效果接近目前最佳的 MJ-V6 及 FLUX 等模型,并支持图片编辑功能。

清言视频通话跨越了文本模态、音频模态和视频模态,并具备实时推理的能力。现在,用户拨打清言的视频通话窗口,即可与它进行流畅通话,即便频繁打断它也能迅速反应。只要打开摄像头,我们看到的画面,清言也可以看到,同时可以听懂指令并准确执行。这样的体验就如同和真人视频通话一样。

继 CogVideoX 2B 版本开源后,5B 版本也于昨日正式开源,性能更强,推理显存需求最低仅为 11.4 GB。同时 CogVideoX-2B 的开源协议调整为更加开放的 Apache 2.0 协议,任何企业与个人均可自由使用。

GLM-4-Flash 现已完全免费,用户可以通过调用 GLM-4-Flash 快速、免费地构建你的专属模型和应用。这也是智谱开放平台首个完全免费的大模型 API 。

官方博文:https://mp.weixin.qq.com/s/Ww8njI4NiyH7arxML0nh8w

微信扫描下方的二维码阅读本文

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。

评论(0)